SBS데이터저널리즘의 오해 – 최근 연구일수록 창의성이 줄어든다?

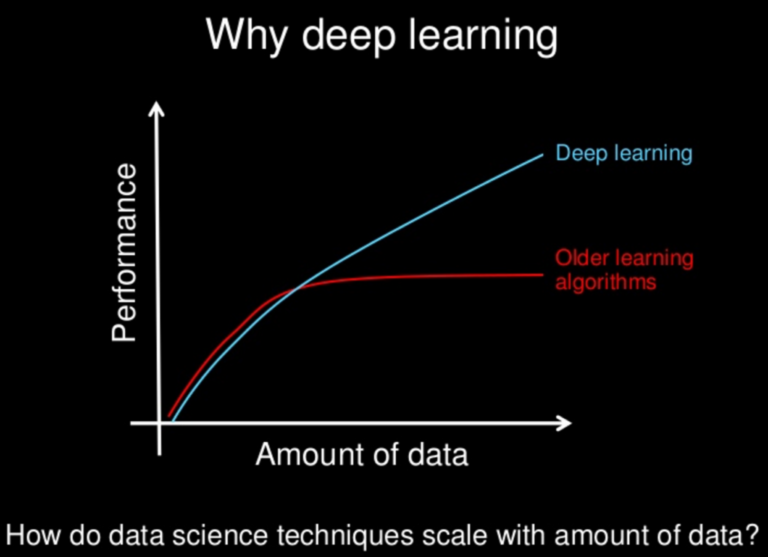

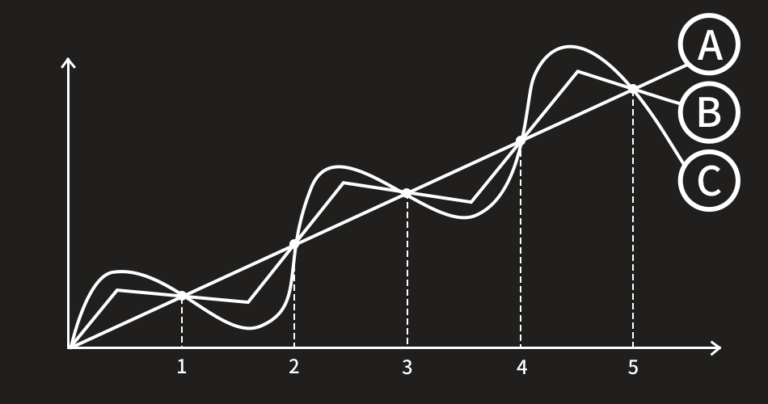

제보를 하나 받았다. 최근들어 논문들의 창의성이 줄고 있다는 주장을 어느 한 논문을 근거로 지상파 방송국 중 하나인 SBS에서 내놨단다. 기존 연구를 인용한 정도가 높으면 창의성이 낮은 논문이라면서 1950년대부터 점점 창의성이 낮아지고 있다고 한다. 공학은, 특히 요즘 들어 AI논문이라고 하면서 Neural Network 모양만 살짝 바꾼 논문이 너무 많으니까 저 논리가 맞을 수도 있겠다는 생각이 조금…